这是一个创建于 188 天前的主题,其中的信息可能已经有所发展或是发生改变。

比较好奇。

1

Lighfer 188 天前 via Android

这个回答很明显是有的,比如可以根据需求(无论是否详细)生成图片、视频,这个在我看来就属于“具备创造力”

|

2

YSHANY 188 天前 非大模型领域,就我了解到的信息,模型达到一定参数以上存在无法解释的现象,就像是模型顿悟一样,有“创造力”,能够解决模型没见过的知识。小参数模型反而更像是“高阶的检索”。至于分界线可能是 7b ?

|

3

mumbler 188 天前 所谓创新,无非是把过去东西重新排列组合,大模型比人重排效率高太多了,所以创新能力也更强

|

4

askfilm 188 天前

"高阶的检索" 罢了。

|

5

trungdieu031 188 天前

有。

|

6

mcone 188 天前 请先定义"创造力"

如果定理是接近于"完全从 0 开始的",那么你想把这个任务交给一个靠预测下一个 token 的语言模型,可能有点想多了 |

7

daybreakfangyang 188 天前 via Android

人类不也一样也在更大框架下进行检索试错

|

8

cmdOptionKana 188 天前

大模型没有创造力,但多数工作不需要创造力,有创造力的人也不多。

创造力的一个重要因素是“问问题”,大模型问问题的能力非常差,而如果不能发现问题、不能问问题,又怎么可能创造?如果由人来对 AI 问问题,由人来启发 AI ,那这个创造力的功劳应该属于人。 |

9

xyooyx 188 天前

我理解 prompt 本身就提供创造力输入

|

10

forgottencoast 188 天前 你要是看了 Andrej Karpathy 的系列讲座,就知道当前大模型的原理,立即可以得出它没有创造力这个结论了。

|

11

duanxianze 188 天前

我不是专家,但我觉得有,我的思考是,人的大脑无非也是信息和算法的集合体,也许某天算力到达某个节点,或者算法上真的模拟出人类的思考过程,真的能创造出人工智能,也就是说,我认为人类也没什么特殊的,无非也是原子分子,无非也是电信号

|

12

tool2dx 188 天前 @forgottencoast 这就是一个量变到质变的过程,没人会认为一个 20b 参数模型有智商,但是 200b ,甚至于 2000b 参数就不好说了。

claude 有发布论文,AI 训练结果只是让概率看起来合理,但中间过程有一套人类无法理解的能量流动,这股能量提前决定了后续概率的预测。仅仅因为输出文字结果是概率排列组合,就判断 AI 没有创造力,还是太草率了。 运行本质内部还是一个黑盒。 |

13

do749533JmKlOC46 188 天前

必然有创造力,比如 Alpha Go 下围棋彻底秒杀人类,未来 1000 年估计都没人能下赢 AI 。

|

14

shendaowu 188 天前

@mumbler #3

这位朋友你是怎么得出大模型可以进行排列组合的结论的?据我所知大模型的记忆力一般就是上下文的大小。就算是这个记忆力我也无法理解它可以进行排列组合。或者你的意思是它可以在人工神经网络中排列组合? 根据我自以为是的可能是创新的经验来看,这个排列组合可能会遭遇组合爆炸,并不是两两匹配就行了。很多创新的关键概念不止两个。我怀疑人脑可能有专门处理排列组合的“硬件”,但是可能无法通过意识访问。这个对应点子凭空冒出来,没有有意识思维的过程。另外想象和实际一般是会有一些差别的,毕竟语言应该是对现实的有损压缩。因此需要通过实践不断纠偏,我理解大模型基本没有实践的能力。我以外行的脑子思考,如果想要不断实践并纠偏的话,可能需要不断训练,这个成本可能很高。使用大模型一般应该都是使用训练好的模型。 |

15

kdd0063 188 天前

先达到能完全自主无监督无数据集,无过程定义地自我攫取知识,自我更新网络再来谈创造力。

|

16

loryyang 188 天前

有的,只是他的思考链路还是比较短的。人类的思考是长期的,但是它迟早能做到的

|

17

MartinYANG06 188 天前

高阶的检索,我猜你的意思是更高效、快速、准确的,通过已有全面完善的数据中,将对应答案找到并整理完善。但是大模型肯定不止于此,因为所有问题不可能穷举,ai 训练有训练集和测试集,测试集相当于大模型没有见过的问题, 这些问题才是真正评估模型性能的关键, 所以在测试集面前不存在检索问题是不存在的。

其次,你可以通过图像模型,图像编辑,变脸,画风迁移,风格融合等 ai 模型的能力看到,这些肯定不是“高阶检索”能办到的事情,视觉图像大模型也是大模型的一种。 在我看来大模型是可以有一定创造能力,至于像人类一样的程度显然还达不到,但至少绝对不至于“高阶检索”能媲美的。 大模型类似实现的是一种数据背后潜在规律的学习和复现 例如现在 deepseek-r1 通过强化学习,使大模型能够学习和实现深度理解和推理能力, 这些都不是“高阶的检索”能够办到的事情。 |

18

murmur 188 天前

你跟知乎水文、今日头条、微信公众号比,AI 的创造力是秒杀好不好

|

19

mumbler 188 天前

@shendaowu #14 大模型的工作原理现在本来就不了解,包括发明 transformer 的前沿科学家在神经网络过于复杂以后都不知道如何推理出来的,只知道这样能工作,跟我们对大脑的了解差不多,人类也不知道自己的大脑是如何运作的。但宏观上来看,无论人脑还是大模型,创新都是原有东西的重新排列组合,大模型思考效率远高于人,排列组合比人更擅长

|

20

min 188 天前

它能排列出人排不出的组合时,或者比人排出得早,就是创新了

|

21

shendaowu 188 天前

@duanxianze #11

虽然我基本认同你的结论。但是你说的细节我有点不同意,我还是比较相信人脑可能利用了量子力学的机制来实现思考的。我前段时间好像看到一篇报道说大脑可能是通过量子力学的方式实现同步的。我理解可能类似时钟信号吧。据说现代 CPU 也会遇到时钟难以同步的问题,很难处理,GPU 可能也类似吧。想要实现强人工智能,要么人类能够有效利用量子力学,要么设计出一种全新的生命让其自行演化,要么可能是人脑根本就没用多少量子力学的机制。我想不到其他情况了。 还有更玄乎的,所谓连接集体意识。这个我感觉可能只是幻觉,不太可信。可能不是这个名字,大意就是你是一个终端,可以连接盖亚那种服务器的意思。我问了一下 deepseek 也没得到什么确定的答复。 另外神经元之间通信不是纯电的,是混电的。 |

22

linofound 188 天前

当然有,创造也就是随机、推理、验证、固定。

|

23

whp1473 188 天前

当然有,创造力就是基于之前的经验做合理推理、验证、总结,所以大模型的幻觉问题不可能解决,这也是创造力的一部分。

|

24

neteroster 188 天前

非业界,只是对大模型有一定了解。

1. 很显然大模型不是所谓的“更高级”检索。大量例子表明 LLM 具有真正的泛化性,至少也是具有“通用模式匹配”的能力。 2. 很多人刚刚了解一点大模型的原理,就以 LLM 是“学习文本统计意义下的预测”这一点来否决 LLM 具有的泛化能力(他们通常还会辅以“LLM 具有幻觉”这一点作为例证)。LLM 是学习文本的统计学规律没错,但是我见过的任何一个持此类观点的人都无法陈述为什么学习统计学规律就无法产生真正意义下的“智能”(事实上,他们甚至无法准确地定义“智能”,就大谈“LLM 永远不可能有真正的智能”),LLM 会产生幻觉这一点也不蕴含 LLM 不能泛化,无法产生“智能”。 3. 与其关注“真正的智能”这种难以定义虚无缥缈的东西,还不如关注 LLM 能怎么用,缺乏什么能力阻止他变得更有用。我在这里得出的严重乃至本质上的需要克服的缺陷有两个:1. 无衰减的超长上下文 2. 持续学习(更新参数的那种)。只要解决这两点,大模型在实际生活生产中的应用可以大幅拓宽。甚至我觉得就凭现在先进的推理模型(比如 Gemini 2.5 Pro / o3 )加上上述两点就能实现非常接近 AGI 的存在。 |

25

shendaowu 188 天前

@mumbler #19 你说的这个东西指的是概念还是物理对象?按照我的理解创新需要同时操作这两者,但是大预言模型在操作物理对象的能力上应该几乎为 0 ,或者有可能也被限制了。我前面说了,我认为语言是对现实的有损压缩,不完全等同于现实,没有实践的思考大概率只是空中楼阁。我还是看不懂你是怎么得出大模型比人擅长排列组合这个结论的。我觉得你说的那些东西不能支持你的结论。当然我说的这些东西也不是很能支持我的结论,但是我没说我的结论很可信。我猜人脑的排列组合可能还包括监控的功能,不然可能就是所有组合都发送给意识处理了。当然只是猜的而已。不知道大模型有没有这个能力,至少为感觉它的监控能力不怎么样。不知道你说人脑排列组合的效率低是不是从工作记忆的角度来看的,或者是从神经元传递信息的速度的角度来看?但据估算仅考虑神经突触,人脑的算力应该也是比大模型大的。这个我搜了一下,没搜到什么,不太可靠,不想详细搜了。人的工作记忆只是人脑功能的一小部分,不能代表人的上限。

|

26

dcatfly 188 天前

要看怎么理解创造力。

比如说当年围棋大战时 AlphaGO 很多棋路都是人类历史上没有出现过的,但确实赢了,这算不算创造力呢? |

27

mumbler 188 天前 @shendaowu #25 “操作物理对象的能力上应该几乎为 0”,你这个断言是不成立的,现在那么多 agent,MCP 就是在为大模型提供操作物理对象的能力,自动驾驶,具身智能都是实实在在影响物理世界,后面会越来越强。

创新是思想上的,鱼+炸弹=鱼雷,柜子+空调=冰箱,做出来并不是最难的,能有这个想象力最难,大模型可以自己组合,自己排除理论上不合理的组合,效率非常高,2024 年诺贝尔医学奖颁给了 google 的蛋白质折叠模型 AlphaFold ,AlphaFold 能造出地球上没有的蛋白质结构,这个创新能力,把大量科学家都搞失业了。 人比大模型强的地方是单位效率高,下一盘围棋,李世石只用 2 个馒头,阿尔法狗要用 2 万美金电费,但大模型效率也在不断提升,而且能叠加,人是不能叠加的,不能说 1 亿人一天就能把癌症疫苗研究出来,但大模型加上量子计算机是可能快速创造任何东西 |

28

shendaowu 188 天前

@mumbler #27 所以你认为思想等同于现实了?那我们应该是没法讨论了。我还是详细搜了一下,人脑的算力有的估计为 2P FLOPS 。好像高于 gpt-4 使用时的算力 3700 TFLOP ,但是好像远低于训练时的算力 2.15e25 。

|

30

forgottencoast 188 天前

@tool2dx

大模型有没有创造力一直都是有争议的话题。 你说的没错,内部目前是有人类无法理解的黑盒。 我说它没有创造力更多的是居于它必须依赖预训练数据的这个事实,就是它给出的所有反馈都是从预训练数据里面来的。 |

31

mumbler 188 天前

|

32

RainySeason 188 天前

画出一幅梵高风格的画是创造力,还是创造出一种新的绘画风格是创造力?

|

33

shendaowu 188 天前

@mumbler #27

第一段的对我的反驳我基本接受了,我之前没想到。但是还有个问题,就是这些大模型好像都局限于特定领域吧?然而很多创新需要跨领域。现在的大模型能自己尝试不同领域的知识吗? 应该是我理解不达标,你好像没有思想等同于现实的意思。我觉得想象难更多是因为大部分人没有专门训练过,或者天生没有那个动力,或者无法忍受那种不确定和瞎想的状态。 |

34

jimrok 188 天前

以现在的模型的结构,还无法产生创造力,但本质上,seq2seq 的模型,是可以产生创造力的。但目前的 transformer 架构不行,至少记忆能力就不好实现,只能靠弄长上下文。人的意识无非就是一束脑电波,seq2seq 的模型就是脑电波的计算场所,人类的神经元结构是可以适应变化的,能够对特征动态调整。但现在 ai 的架构不行,太固定了。

|

35

Shanky 188 天前

我觉得大模型已经比很多 B 站,V 站,抖音,网易新闻下的评论的智力/创造力要高了

|

36

Rickkkkkkk 188 天前

只能说比绝大多数人的创造力强。

|

37

mumbler 188 天前

@shendaowu #31 目前最强的模型 gemini2.5 pro 智商 130 ,我有一道题,别的模型都老老实实去翻译了,只有 gemini2.5 发现了问题,这不是英语,这是一道语文题,直接给出了杜甫《春夜喜雨》的答案,你说他能不能跨学科?他就是个人

请用最优美的汉语,翻译下面的英文 Joyful rain knows their prime, It will arrive in spring time. Breeze and raindrops whisper at night, Creatures are nourished and brought to life |

38

shendaowu 188 天前

@mumbler #31

1. 我之前还真基本上将大语言模型和大模型等同了,我的错。但是大预言模型应该是唯一整合了不同领域知识的大模型吧?而其他的能操作现实的大模型都是具体领域的吧?如果是的话这是否能说明什么?比如大模型无法整合不同领域的知识进行创造之类的。这算是我的“垂死挣扎"吧,我已经没有能说服你的希望了,我的信念也基本被改变了。我的信念基本等同于观点,但是我不喜欢观点这个词。 2. 你是在阴阳我还是真那么想的? |

39

mumbler 188 天前

@shendaowu #38 你想表达的意思术语叫 AGI ,通用人工智能,就是不需要我们用 prompt 去驱动,可以像人一样交流,完成各种工作,chatgpt 诞生后,业界普遍认为 AGI 不存在障碍了,奥特曼和李开复都表达过,预计最早 2027 年能实现 AGI ,但 AGI 早期可能非常贵,我们目前的电力水平可能还不配拥有 AGI ,需要可控核聚变做出来才行

|

40

Muniesa 188 天前

我认为强化学习有效就证明了本身具有创造性

|

41

crossoverJie 188 天前

|

42

raydied 188 天前

1 、比高阶检索多一些,以前是穷举条件+分段函数,现在可以不用处理这些逻辑。

2 、降低了自动化的门槛。如,可以用自然描述的方法写脚本,特别是 agent 方面 tool 的编辑。 |

43

gpt5 188 天前

@crossoverJie 昆哥和 facebook 推世界模型,是利益相关方,所以不可全信。

|

44

catazshadow 188 天前 via Android 为什么对随机鹦鹉有这么高的期待?

哪怕用太阳当能源这玩意就就是个倒腾符号的机器 |

45

hjq632233317 188 天前

别人企业不知道 但是就我们公司来说 我们要的就是高阶检索总结检索结果,而且希望越准确越好 不需要他的创造力

|

47

wyntalgeer 188 天前

取决于你怎样定义创造力,如果是由无到有,那人类也做不到。例如说:请画一个四维空间出来

|

49

vx7298 188 天前

创造力的概念,不精准。你能问一个目前没人问过的问题,它给你回答一个没人回答过的答案,这就叫创造力,可以不?貌似这 2 点你都没测试数据

|

50

horizon 188 天前

你如何定义创造力

|

51

anan1314git 188 天前

@catazshadow 我从没见过一个鹦鹉能写代码,写论文,画油画,做音乐, 做视频, 如果真有这么一只鹦鹉, 我愿意相信这只鹦鹉有创造力

|

52

2018yuli 188 天前

为什么对随机鹦鹉有这么高的期待?

|

53

wangyzj 188 天前

如何定义创造力

|

54

qiuhang 188 天前

根据我这半年的使用体验来说,我觉得是有的。但是看你怎么定义创造力?如果你是说,让它去自己收集规律,观察分析规律,找出牛顿三定律之类的,那是没有的。但是你要说给它个固定的题目,让它自我发挥一下的话,还真能给你整出来点新东西。

|

55

catazshadow 188 天前

|

56

yankebupt 188 天前

大模型可以做到,根据小程序A的例子,把小程序B的某某某功能改成C……

有没有创造力不知道,以前这得招个实习生或者自己捣鼓一个小时。 |

57

KKKKBBBB 188 天前 via iPhone

@forgottencoast 但是人类也无法凭空想像出从没见过的东西,而是必须立足于已有的东西,这点从科幻小说的创作就能看出

|

58

nicholasxuu 188 天前

大部分的人也没什么创造性呀。

大部分所谓的创造,也很实验性,最后也是失败的。成功的也是凤毛麟角,其中一部分还被抄走了。 但大模型不止是检索,也有一些推理能力的。但他的检索能力+简单的推理能力,已经比很多初级甚至中级人员强不少了,成本低速度快。 |

59

dog82 188 天前

前段时间狂看深度学习相关的书,一开始觉得不就是一堆权重+非线性变换么……

|

60

windyCity1 188 天前

@yankebupt 你描述的这个应该是生产力,不是创造力。大模型在一些场景下可以提高生产力,这个应该是算共识了

|

61

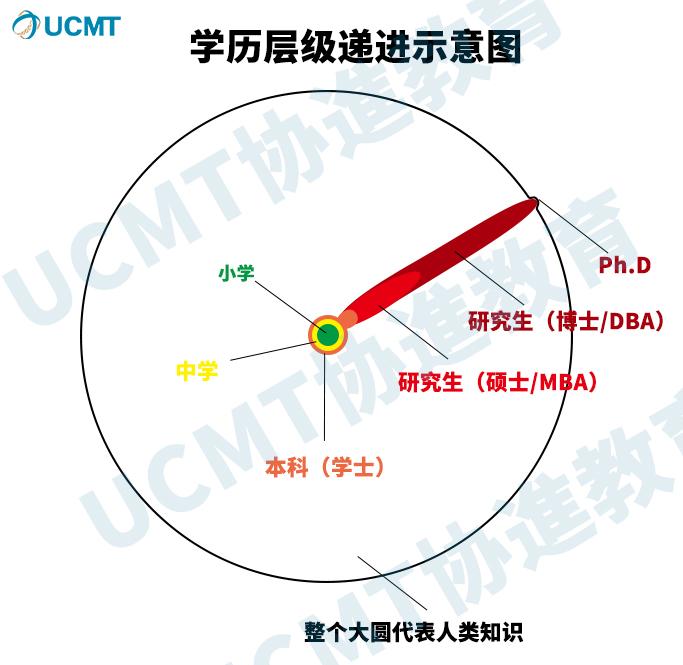

levywang 188 天前

人本身的创造力也是基于现有知识的衍生,大模型当然有创造力,而且比 99%的人类做的更好。

有个图片能很好的说明,博士水平才突出了人类知识的边界。  |

62

iOCZS 188 天前

创造力的本质也是检索吧。。。

|

63

smlcgx 188 天前 via iPhone

@dog82 其实就是这么回事,李宏毅网课开头就说了,neural networking 早就臭大街了,但是你要发论文要吃饭,那怎么办?咱们改个名字叫 deep learning 吧

|

64

particlec 188 天前

不是检索呦,因为 ai 有时候会瞎编!

|

65

shylockhg 188 天前

@catazshadow 人类也只是倒腾符号的机器

|

66

catazshadow 188 天前

@shylockhg 这种说法忽略了脑子里比现在这种粗鄙的“神经网络”细节丰富的多的物理活动,是及其自大的

|

67

hahiru 188 天前

人类无法想象认知以外的事情。所以人类到底有没有创造力,还是东拼西凑的结果还犹未可知。

|

68

iyaozhen 188 天前

有没有创造力 这个还有争议,但偏向是有的

但可以确定的是 更“高阶的检索” 这个认知是错的 |

69

yankebupt 187 天前

@windyCity1 目前的创造力可能在能独立制作出原创梗并在人类范围中流传的地步吧……

真正的创造力要突破人类认知边界,太难了……deepseek 的推理估计做不到,openai 的那个闭源,你不知道他怎么实现的,高阶模型也太贵评测太少,所以无法讨论。 |

70

superedlimited 187 天前 via iPhone

@forgottencoast 感谢你让我知道了 Andrej ,他真的好可爱☺️

|

71

forgottencoast 187 天前

|

73

qingyingwan 186 天前

大模型没有创造力,反证法:如果大模型具备创造力,那就让他设计更高效更智能的大模型,即使提升 1%,然后自己更新自己反复迭代,也就是超级人工智能。然而现在没有。

现在的大模型有两个致命缺陷:训练资料有限,以及无法增量学习新知识进行自我迭代。 训练资料有限很好理解,说下第二个,想想人类是怎么从无知到具备创造力的:实际是就是自我迭代,人的经历,见闻,主动被动的学习都是不断的自我迭代,只是速度很慢,可能你一周才学会一个物理定理,但跟大模型比就是吊打。因为大模型没法自我迭代,要想迭代就需要训练一个新的大模型。 然后说到创造力 技术上的创造其实就是三步:1. 持续学习+自我迭代 2. 更新对环境的认知,发现和解决问题 3. 回到第一步 文学艺术上的创造力:1. 对生活,对世界,对生命等等,的体验,经历和情感 2. 情感的表达 3. 情感的共鸣 以上的前提,大模型都不具备,所以那些说大模型有创造力的,先想想自己有没有创造力。。。。。 艺术领域大模型所谓的创造力:说个最有创造力的:写诗 如果有人说大模型写诗是创造力的表现,那我要笑了,初中的诗歌赏析还得结合历史背景,诗人的经历,当时的政治环境等等因素,不是景色写的美丽就是好诗,还需要写出忧国忧民,怀才不遇,壮志未踌等等。而大模型又没有人生经历,写出来的东西能使人共鸣吗 科学领域大模型最有创造力的:可能是分析蛋白质结构,纯苦力,其他的我实在没法想 比如万有引力的发现,有几个前提:1. 牛爵爷体重几十斤,自己能感受引力 2. 牛爵爷看到所有东西都会掉到地上,3. 牛爵爷研究搞出了牛逼的数学工具,提出了引力理论并用实验证明有效 更不用说后面的相对论,量子力学,各种场论了。 这些都是创造力的表现,目前的 AI 看不到一丁点可能达到那个水平。 创造力不是基于现有知识的衍生,而是学习现有知识+自我迭代+观察总结发现+好奇心等等因素,基于现有知识的叫改良优化,死读书的那种是没有创造力的,打个英雄联盟都会跟不上版本 |

74

mumbler 186 天前

@qingyingwan #73 强化学习就是半自动的自我迭代,像阿尔法狗后期就不用人类棋谱学习,完全用自我对弈数据学习就远远超过人类,现在大语言模型主流训练方法也都是用自己生产的合成数据,智力得到很大提升,而且没有远到天花板的迹象,这样一代代迭代下去,按这个速度预计最早 2027 年实现 AGI ,就可以实现全自动自我迭代了

|